相続の相談でいちばん多い失敗は、

「税理士に行ったら登記の話ができず、司法書士に行ったら税金が分からない」ことです。

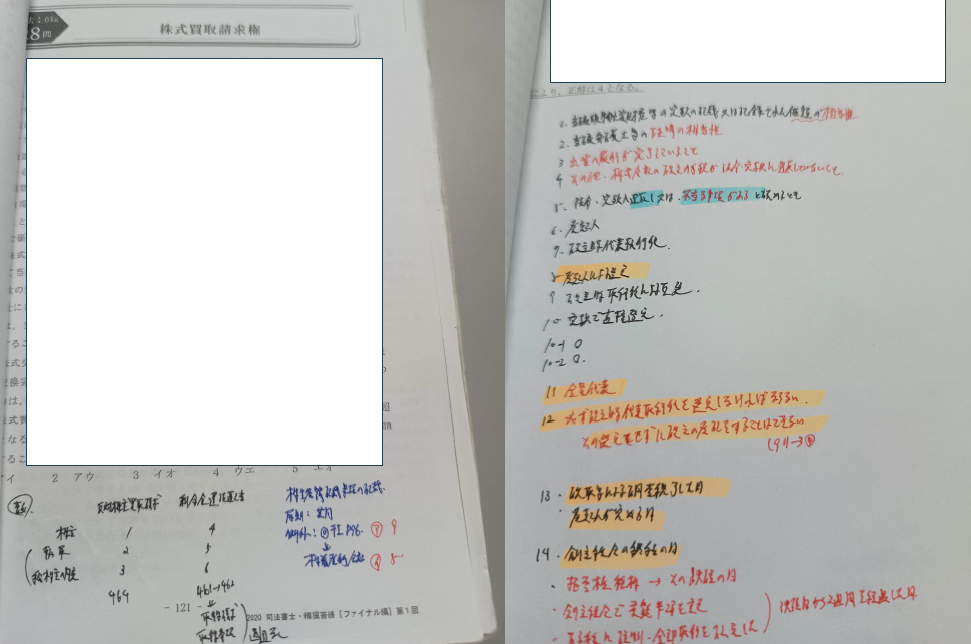

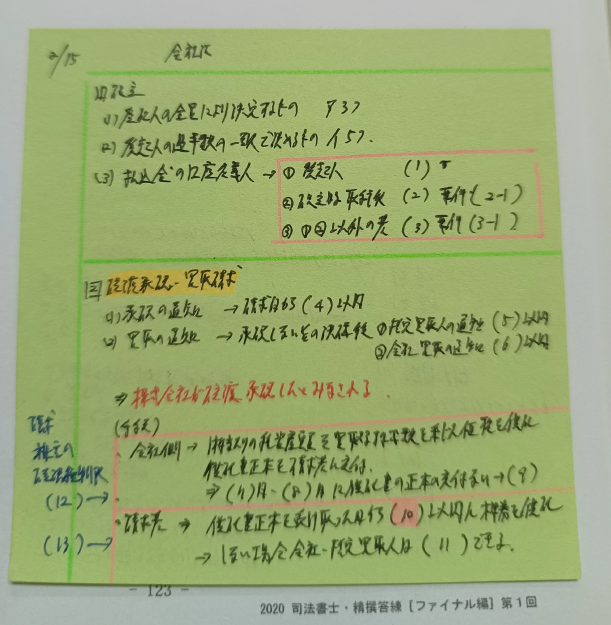

司法書士試験対策-因果律を理解できるようにするには

私が受験生時代にやっていた学習方法の一つが、自分で理解できていない範囲の穴埋め問題を作り、ルーティーン学習に組み込んでいました。予備校の模試や過去問の下の余白に、関連する条文や解説を穴埋め形式で書いておき、問題を解いた後についでにキーワードとなる用語を実際に書いていました。答えは裏の余白に書いておき、正確に用語を覚えているのかを毎回確認していました。先日、ホリエモンちゃんねるで高度な脳機能をAIに理解させるために、大量の穴埋め問題を学習させることで、飛躍的に賢くなり、入れるデータの桁数を増やすことで、指数関数的に賢くなったそうです。この辺りを一般的な学習方法として取り入れればと思い、解説していきたいと思います。

目次

1.私がやっていた学習方法

2.人間の学習とAIの学習

3.人間とAIの相違点

4.まとめ

1.私がやっていた学習方法

まず、民法なんかは実生活に関連しているものもありますので、理解しやすい範囲から手を付けていき、理解できないものについては、暗記で乗り切ろうとしました。会社法は、ほぼ暗記と言っていいんじゃないでしょうか。そう言った暗記の部分をどのように効率的に学習するのかによって、受験回数が飛躍的に短縮できるものと考えます。

単純暗記は、記憶に定着しづらいのがネックです。そう言ったとき、因果関係を理解することで、その事項の「流れ」を理解できますので、数珠つなぎのようにすらすらと原因から結果に向かう過程で思考が生まれてきます。これをうまく定着させるツールとして、穴埋め問題を使っていました。

その発展形で、例えば会社法の「自己株式を取得できる場合と財源規制」を暗記した際に、それぞれの項目について、書き出せるようにまとめた表を暗記し、株券提供公告を何も見ないで書けることを確認した後に、それぞれの重要論点を何も見ないで書いていくこともしていました。これも穴埋め問題の応用ですよね。

2.人間の学習とAIの学習

ホリエモンちゃんねるで話をしていたことについて、少し触れたいと思います。

(引用開始)「子供の学習について、「認知」は比較的簡単にできます。例えば、目の前にコップがあれば、コップがあるということはわかります。でも、抽象的な概念である「因果律」や「接続詞」は理解できない子供が相当数います。そして、理解できない人たちは、その部分を読まない。

人間はバーチャルな概念(抽象的な概念)を理解できるが、できない人が一定数いて小学校とかのクラスには何人かいます。繰り返し朗読をすることによって、とりあえず表面的には、そういったリアクションとか、「しかし」リアクションっぽいことはなんとなくできるようになります。ただ、本質的には理解していないので、twitterとかで「○〇リプ」飛ばしてくる人は、「しかし」が理解できていない可能性が高いです。私(ホリエモン)が、しかしと書いているのに、「しかし」を読み飛ばすので全く反対のことを私(ホリエモン)が言っているという風にとらえている可能性がある。多分そうだと思う。

穴埋め問題も、たとえば時系列とかその因果関係とかを理解できないと穴埋め問題は解けないんですよ。そういう人が一定数いる。

興味深いAIの話で、chatGPTとかにつながる話を1年半ぐらい前に、エライザというAI作ってる大規模言語モデルLLMの英語ベースが最初なのですが、東大松尾研の出身者がやっている日本語部分を強化したLLMも作っているエライザという会社があって、そこの社長のインタビューしたときに、どうやって大規模言語モデルを作ったのか聞いてみた。

トランスフォーマーというものがGoogleの研究所にあり、これがベースになっているそうなのですが、その上にchatGPTなどがその流れの中にあります。

最初の一歩は「認知」じゃないですか。ディープラーニングをやって最初に成果を上げたのは、画像認識です。画像認識は、脳科学の分野でいえば認知なわけです。そこから、高度な認知とか運動とかの低位のものを統合して思考とかする高度な脳機能の前頭前野とかでやっているような部分をどうやってやらせたかっていうと、「穴埋め問題を解かせた」んですよ。大量のデータを穴埋め問題にして、そこに何が入るのかっていうことをAIに入れたら、飛躍的に賢くなって、しかも入れるデータの桁数を3桁とか上げたら、指数関数的に賢くなったという部分で、chatGPTが注目されている理由なんです。が、それってもしかして因果律理解しているの?表面的に因果律が理解しているような挙動を示すわけですよ。これって人間じゃないですか。・・・・・・・」(引用終わり)

すごく興味深く聞き入ってしまいました。AIのディープラーニングに穴埋め問題を解かせることで因果律がわかるようになった話です。全員とは言いませんが、人間にも効果的な学習として機能するのではと思ってしまいます。私自身、穴埋め問題を活用していましたから。

3.人間とAIの相違点

人間は、与えられたデータをその場では処理できても、時間がたつと忘れてしまいます。しかし、AIは処理したデータを経験値としてずっと残しておくことができます。

人間には反復継続が必要な理由がこれです。以前、このブログで、学習方法について記憶の種類分けで学習効率を上げる記事を書いていますので、是非見てください。

4.まとめ

昔、塾講師のアルバイトをしていた時に、国語の問題を解かせると、ものすごく点数がいいときと、全くできないときの落差が激しい子がいたんです。よくよく見てみると、難しい漢字が読めていないことがわかりました。問題文を音読させたんです。そうすると難しい漢字を飛ばすものだから、ほとんどひらがなしか読んでいない状態でしたので、解けないのは当たり前です。できるときは、詩や難しい漢字が少ない問題のケースでした。ですので、読めない漢字の読み方を次回までに読めるようにする宿題を毎回出して、高校受験に間に合わせました。

このように、できないパートを飛ばしてしまうと因果律としてとらえることすらできない状態になってしまいます。できないことをすべて克服するのは不可能です。ある一定の理解できている状態まで持ってこないと、学習内容の因果律は理解できません。ですので、まず年内は、できる引き出しを一つでも多く蓄えていきましょう。そうずれば、味のないガムのような会社法も、なんとなく味が出てくるかもしれませんよ。

最新のブログ記事

相続法律・税務無料相談会のご案内

**「香川県高松市で開催する、司法書士・税理士による相続法律・税務の無料個別相談会の案内ページ。」

【なぜ成功者は叩かれるのか】森岡毅氏の炎上から考える“失敗できない社会”の危険性と本当の成長戦略

「なぜ成功している人ほど叩かれるのか?」

マーケターとして著名な森岡毅氏の事例を見て、そう感じた方も多いのではないでしょうか。

綾川町・さぬき市の相続登記|義務化で「今さら登記」が急増中?間に合わなくなる前の生前対策とは

「相続登記が義務化されたと聞いて慌てて来ました」――。

綾川町やさぬき市、東かがわ市では、こうした"駆け込み相談"が急増しています。しかし実際には、相続人が認知症になっていたり、連絡が取れなかったりして、手続きそのものが進められないケースも少なくありません。相続登記は「後でやろう」では間に合わない時代です。今回は、現場で増えている実例とともに、生前にできる具体的な備えを解説します。